Голос «Дії» — не українській компанії. Чому обрали ElevenLabs, а не Respeecher — розбираємо деталі партнерства

Аудіо версія Як це працює

Режим читання збільшує текст, прибирає всю зайву інформацію зі сторінки і дозволяє зосередитися на матеріалі. Тут ви можете вимкнути його в будь-який момент.

Слухайте з будь-якого місця

Україна будує технологічний суверенітет, інвестує в оборонні стартапи, підтримує локальних розробників. Водночас коли справа доходить до критичної державної інфраструктури — обираємо іноземного гравця, а не українську команду, яка, до слова, не помічена у скандалах і має голлівудські контракти. Чому?

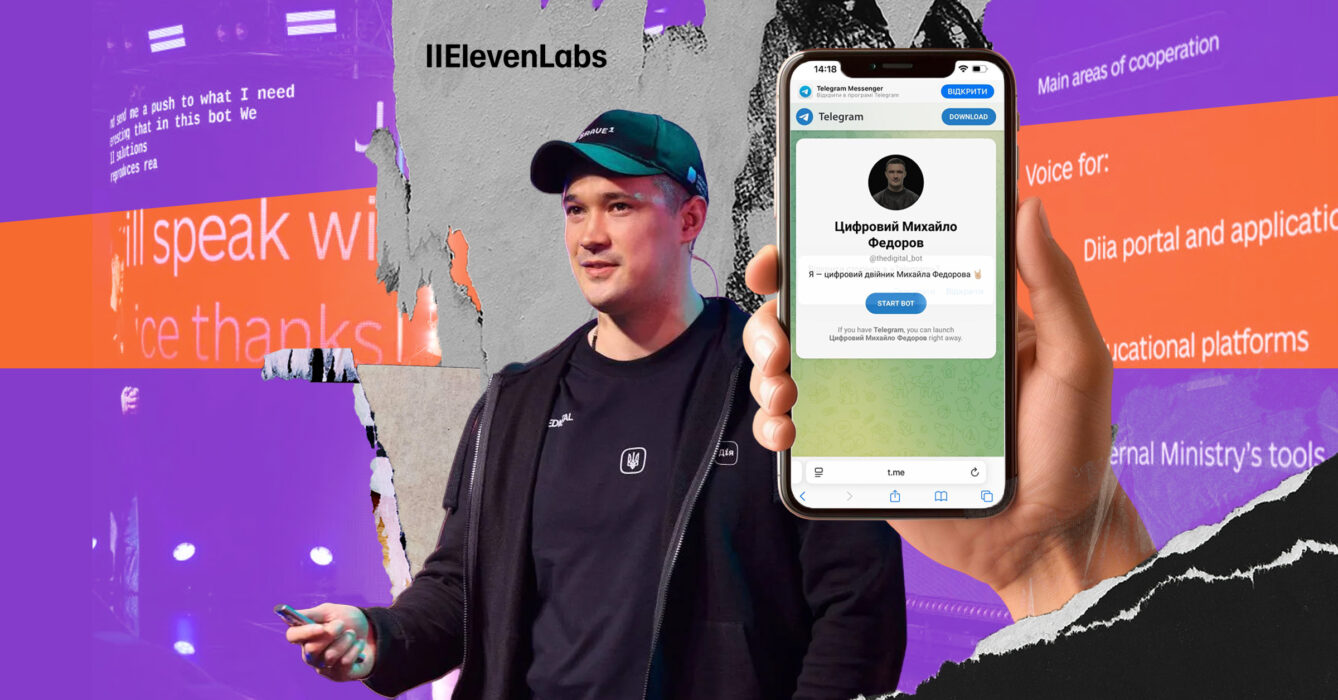

На IT Arena 2025 Мінцифра оголосила партнерство з ElevenLabs — ШІ-єдинорогом, що має озвучити держсервіси. У планах — голосова «Дія» й розмовний цифровий двійник Михайла Федорова.

Втім, залишається кілька важливих запитань. Чому обрали іноземну ElevenLabs, а не український Respeecher? Як держава захистить дані, якщо технології єдинорога вже ловили у діпфейках та дезінфо?

Журналістка Vector Дарія Прудіус з’ясувала:

- як міністерство обґрунтовує свій вибір і оцінює ризики інтеграції технологій іноземного партнера;

- що кажуть в самій ElevenLabs;

- а Олександр Сердюк CEO Respeecher пояснив, які є технологічні альтернативи.

Оригінальна дата публікації: 4 листопада 2025 року.

Що відомо про ElevenLabs

ElevenLabs — це ШІ-компанія з Нью-Йорка, заснована у 2022 році двома колишніми працівниками Google і Palantir. За три роки стартап виріс до оцінки $3,3 млрд і став одним із найшвидших ШІ-єдинорогів в історії. Останній раунд фінансування серії С у січні 2025 року приніс компанії $180 млн від VC, серед яких Andreessen Horowitz (a16z), ICONIQ Growth, Sequoia Capital та New Enterprise Associates (NEA).

Технологія ElevenLabs спеціалізується на двох напрямах: voice cloning (клонування голосу) та conversational AI (розмовний штучний інтелект для діалогу в реальному часі). Саме другий напрям, за словами Мінцифри, став ключовим для вибору партнера — можливість вести живий діалог з користувачем, а не просто програвати заздалегідь записані фрази. Компанія працює з Netflix, The Washington Post, підтримує понад 30 мов, включно з українською, має понад 1 млн зареєстрованих користувачів та обробляє понад 50 млн запитів щомісяця. На папері схоже на ідеального партнера для масштабних проєктів.

Чому не все так однозначно

Але репутація ElevenLabs не така ідеальна, за три роки єдиноріг встиг зібрати портфоліо з гучних репутаційних кейсів.

Дезінформкампанія Operation Undercut

Найсерйозніший кейс — російська дезінформаційна кампанія Operation Undercut, спрямована на підрив європейської підтримки України. У грудні 2024 року американська компанія Recorded Future оприлюднила розслідування: російська Агенція соціального дизайну (SDA) «дуже ймовірно» використовувала голосові інструменти ElevenLabs для створення фейкових новинних відео англійською, німецькою, французькою та польською мовами.

Дослідники підтвердили використання технології ElevenLabs через власний детектор компанії — AI Speech Classifier, що показав збіг. Мета кампанії — приховати російське походження контенту та посіяти недовіру до підтримки України. ElevenLabs заблокувала акаунти після виявлення, але факт залишається: технологію використали саме для пропаганди проти нашої держави.

Діпфейк Байдена і втручання у вибори

У січні 2024 року технологію ElevenLabs використали для створення діпфейк-дзвінка, який імітував голос президента США Джо Байдена. Фейкове звернення закликало виборців у Нью-Гемпширі не голосувати на праймеріз Демократичної партії. Компанія Pindrop Security встановила з «понад 99% впевненістю», що для підробки використовували ElevenLabs. Власний детектор компанії показав 84% ймовірність.

Справу розслідують як кримінальний злочин. ElevenLabs заблокували акаунт після інциденту, але питання залишається: як дзвінок взагалі міг відбутися, якщо компанія стверджує, що автоматично блокує голоси політиків?

7500 незаконних клонів голосу

У 2024 році організація Rights Alliance Rights Alliance — данська організація, що з 2011 року бореться з цифровим піратством і захищає права власників контенту. Замінила Anti-Piracy Group, змістивши фокус із покарань користувачів на зміну поведінкових норм і співпрацю з владою та індустрією. виявила і видалила з платформи ElevenLabs 7500 незаконних клонів голосу актора Девіда Бейтсона, створених без згоди власника. Для клонування голосу користувачі повинні були лише поставити «пташку», підтверджуючи дозвіл. Дослідження Consumer Reports показало: ці «захисні заходи» можна легко обійти — система довіряє на слово.

Восени 2024 року актори озвучування Карісса Вакер та Марк Бойетт подали позов проти ElevenLabs. Вони стверджують, що компанія незаконно клонувала їхні голоси для створення дефолтних голосів Bella та Adam, використавши аудіокниги без дозволу. Позов містить звинувачення у порушенні DMCA — обході технологічних заходів захисту авторських прав.

Слабкий захист правовласників

У березні 2025 року Consumer Reports протестували шість провідних ШІ-сервісів для клонування голосу — п’ять із шести мають легко обхідні захисні бар’єри. Достатньо кількох секунд аудіо з TikTok чи YouTube, щоб система згенерувала голос людини у синтетичний файл. Без належних захистів будь-хто, хто зареєструє акаунт, може завантажити чужий голос і почати його використовувати.

Чотири сервіси — ElevenLabs, Speechify, PlayHT та Lovo — просто вимагають поставити «пташку» про згоду власника голосу. Жодної верифікації. Resemble AI вимагає запис аудіо в реальному часі, але дослідники Consumer Reports легко обійшли це обмеження, просто програвши запис із комп’ютера. Детекшн-софт для виявлення діпфейків часто не розрізняє реальні та синтетичні голоси.

Витік через партнера

У червні 2024 року в Rabbit, партнері ElevenLabs, виявили серйозну вразливість: інженери жорстко закодували API-ключі ElevenLabs в AI-пристрої R1. Це дало хакерам повний доступ до історії всіх text-to-speech-повідомлень, можливість змінювати голоси, додавати свої тексти та атакувати всі R1 одночасно.

Хоча проблема була на боці Rabbit, інцидент показує ширшу картину, що навіть партнери з API-доступом можуть створювати масштабні ризики безпеки.

Ненависницький контент

Розслідування Motherboard виявило випадки використання технології ElevenLabs на форумі 4chan для створення образливого контенту. Користувачі генерували синтетичний голос актриси Емми Вотсон, яка читає уривки з Mein Kampf Гітлера, створювали голоси з гомофобними, трансфобними та расистськими висловлюваннями.

Як реагує ElevenLabs

Бізнес-модель «єдинорога» побудована на ШІ-перегонах зі швидкістю світла. У відповідному темпі маємо й анонси нових фічей та опцій. Варто згадати, що у листопаді 2024-го ARR виріс до $90 млн — із $25 млн роком раніше (приріст на 260%). До того ж інвестори на кшталт Andreessen Horowitz чи Sequoia Capital не вкладають сотні мільйонів у компанії, які рухаються обережно.

Проблема в тому, що «оперативно розібратися з наслідками» щодо ШІ-голосу означає не просто виправити баги в інтерфейсі. Наприклад, після скандалу з діпфейком Байдена компанія впровадила No-Go Voices — політику заборони клонування голосів політиків. Після критики посилила співпрацю з правоохоронцями. А після кампанії з дезінформацією додала водяні знаки і верифікацію.

Нині відомо, що ElevenLabs впровадила такі безпекові заходи:

- Voice Captcha для перевірки права на клонування голосу.

- Автоматичне блокування голосів політиків та знаменитостей (хоча кейс Байдена показує, що система неідеальна).

- Партнерство з Reality Defender для виявлення діпфейків.

- Детальна Prohibited Use Policy, що забороняє використання для політичної агітації та дезінформації.

- Блокування акаунтів у росії та Білорусі через геозаборони.

Загалом для Кремнієвої долини прийнятно випустити продукт, зібрати мільйони юзерів, а потім латати дірки в безпеці. Згадаймо проблеми таких мастодонтів як Spotify з піратством, чи Facebook із приватністю.

Компанія має сертифікацію міжнародного стандарту безпеки даних SOC 2 Type II

Проте все це впроваджується після скандалів. Кожен такий інцидент показує, що технологія випереджає контроль. Для держави, яка інтегрує таку технологію в критичну інфраструктуру, найкритичніше не в тому, чи ElevenLabs реагує на проблеми. А в тому, чи готова Україна стати частиною цього експерименту — запускати технологію спочатку, а розбиратися з наслідками потім.

Що обіцяє Мінцифра

Дисклеймер: На запит Vector у Мінцифрі надали коментарі без тайтлу конкретного спікера — лише узагальнену «позицію міністерства». Так само і ElevenLabs — без конкретного спікера.

Навіщо нам голос у «Дії»

«Інтеграція голосових технологій у держсервіси — це про зручність і доступність», — пояснюють у міністерстві. Людина зможе спілкуватися з державою голосом, не набираючи текст. Таке рішення особливо важливе для тих, кому складно користуватися клавіатурою або смартфоном.

У Мінцифрі посилаються на світові тренди: 62% щоденних активних користувачів WhatsApp використовують голосові повідомлення, ChatGPT і Gemini активно впроваджують голосові функції: «Ми хочемо, щоб Україна, а особливо державні продукти, не відставали від цього ритму».

Перший кейс — цифровий двійник Михайла Федорова, через якого можна голосом залишити ідею чи фідбек про держпослуги. У планах — інтеграція голосових функцій в «Дію».

Амбіції зрозумілі, хоча варто зазначити: цифровий двійник міністра — це інструмент для комунікації та збору фідбеку, а не держпослуга в класичному розумінні. Реальна інтеграція в «Дію», яка дасть громадянам можливість замовити довідку чи записатися на прийом голосом, це поки що в планах.

За якими метриками оцінюватимуть ефективність

Зараз у цифровому двійнику Федорова тестують голосові функції. «Це чат-бот, тому ми можемо відстежити обмежену кількість метрик. Ключова — який відсоток користувачів спілкується голосом замість набирання тексту, це показує реальний попит».

Після інтеграції в «Дію», кажуть, зможуть досліджувати більше метрик і покращити досвід користувачів. Конкретних цифр та термінів міністерство поки не розкриває.

Де зберігатимуться записи голосів українців

«Ми використовуємо технології ElevenLabs у режимі Zero Retention Mode — це означає, що голоси користувачів не зберігаються на серверах ElevenLabs, і компанія не може їх використовувати у власних цілях».

У самій ElevenLabs про процедури безпеки відповідають так: «Якісне клонування голосу людини можливе лише за прямою згодою користувача. Щоб клонувати свій голос, особа повинна у режимі реального часу пройти процес верифікації, озвучивши певну фразу на екрані тут і зараз».

За цією процедурою створювався голос Федорова для цифрового двійника. ElevenLabs також має перелік осіб, чий голос не можна клонувати — туди входять відомі особи та політики, щоб запобігти створенню діпфейків.

На запитання про конкретні інциденти — Operation Undercut проти України, діпфейк Байдена, 7500 незаконних клонів голосів — у Мінцифри відповіли тейком, з яким насправді складно посперечатись — «використання платформ і технологій для пропаганди є загальним викликом для великих технологічних компаній».

ElevenLabs додають: «Забороняє використання своїх послуг у росії та Білорусі, активно блокує акаунти, які намагаються обійти ці заходи, та постійно виявляє непрямі способи зловживання технологією». ElevenLabs також має позицію, за якою «засуджує збройну агресію росії проти України та серйозно ставиться до питань безпеки».

Хто перевірятиме безпеку системи та чому неукраїнські альтернативи

«Кожен продукт із ШІ проходить дві незалежні перевірки на безпечність: командою Blue Team, яка оцінює архітектуру, і Red Team, яка тестує систему на стійкість до атак», — відповіли в Мінцифрі. Ці команди працюють автономно від розробників, щоб уникнути конфлікту інтересів. Лише після цього продукт отримує дозвіл на запуск.

Мінцифра підкреслює, що працює не тільки з міжнародними партнерами, а й залучають українські IT-компанії до розроблення державних рішень. Так, уже співпрацюють з SoftServe, EPAM, KitSoft.

Щодо ШІ-проєктів — WINWIN AI Center of Excellence працює над великою мовною моделлю разом з «Київстаром». «Паралельно спілкуємося з кількома українськими компаніями щодо їх участі в інших ШІ-проєктах Мінцифри. Щоб уникнути ситуації вендорлоку та мати суверенний ШІ, Мінцифра почала роботу над створенням в Україні державної ШІ-інфраструктури».

Деякі ключові питання поки що ми не можемо дізнатися з міркувань безпеки — чітких KPI та термінів, а гарантії безпеки наразі базуються на заявах самої компанії-партнера. Крім того, хотілося б розуміти, який у держави план дій у разі проблем з ElevenLabs, хоча б приблизно. Поза тим, у міністерстві наголошують, що вже тестують технології та поступово їх впроваджують.

Водночас у Мінцифрі запевняють, що обирають технології, а не бренди. За їхніми словами, для живого діалогу з державою потрібен саме conversational AI («розмовний ШІ»), який реагує в реальному часі. Respeecher, за словами міністерства, є сильною компанією у своїй ніші, і вони відкриті до можливої співпраці — проте поки не знайшли відповідний кейс для цього.

Позиція Respeecher

Чи справді потрібен саме «розмовний ШІ»

На наше запитання про «розмовний ШІ», а не клонування голосу, Сердюк спростував цю різницю.

Він пояснює, що у «Дії» є власний асистент, і для того, щоб він заговорив, необхідно просто з тексту створити голос. Це технологія синтезу мовлення (text-to-speech), і вона у Respeecher є. Вони запустили її нещодавно українською мовою — із затримкою в 200 мілісекунд, що є індустріальним стандартом, з якісними українськими голосами без дивних акцентів, які нині переважають на ринку.

За словами Сердюка, відмінність між тим, що потрібно Мінцифрі, і тим, що пропонує Respeecher, не така принципова. Йому здається некоректним саме запитання про різницю, бо для того, що робить Мінцифра, їм треба саме синтезований голос.

Він формулює власний кут зору інакше: «Тут питання трохи іншого характеру — чому обирається провайдер, який більш глобально відомий, а не локальний український бренд, який себе зарекомендував у Голлівуді?».

І додає: «На нашу думку, надзвичайно важливо вибирати не тільки технологію, а й репутаційно дивитися в те, хто є провайдер цієї технології. Особливо, якщо це державний орган».

Про репутацію вендора

Сердюк не зачіпає та не критикує конкурентів в розмові, натомість відверто говорить про власні відчуття. Каже, йому особисто дискомфортно, що його дані як користувача «Дії» можуть піти до компанії, технологія якої була використана в пропаганді проти України та втручанні у вибори.

Тож із цього розгортає ширшу тезу про індустрію: зараз існує два світи. Перший вірить, що етика буде драйвити цей бізнес у майбутньому — це світ Respeecher. Інший компрометує етику, знижуючи контроль над потенційно неетичними використаннями технології, і вірить, що технологічні компанії диктуватимуть, куди рухається синтезований голос. Це два кардинально різні підходи.

Respeecher, за словами Сердюка, робить ставку на етику — навіть якщо це означає менший бізнес. «Ми репутаційно абсолютно чисті. Відмовились від дуже великого бізнесу через наші етичні принципи. Можна подивитися на конкурентів у світі — ті компанії, які компрометують етичні принципи, вони зараз більші, ніж Respeecher».

Він пояснює: «Наша ставка на етику — і не тільки тому, що це бізнес-рішення, а тому, що ми не хочемо витрачати своє життя на те, щоб з нашою технологією робили порнуху».

Чи достатньо Zero Retention Mode

Чи достатньо Zero Retention Mode від ElevenLabs для гарантування безпеки, Сердюк не береться судити: він не є спеціалістом, що може оцінити безпеку конкретного провайдера, особливо враховуючи, що це конкурент Respeecher.

Однак формулює інші критичні запитання, які цікавитимуть дедалі більше людей: куди йдуть дані? Чи використовуються вони для тренування глобальних моделей? Яким чином контролюється їхня безпека?

Натомість Сердюк розповідає, як це працює у них: «Respeecher може розгорнути систему всередині компанії, яка її використовує. Таким чином дані не будуть взагалі злиті».

Чому це можливо? Respeecher з самого початку працював на малих обсягах даних. «Для Едріана Броуді

На відміну від конкурентів, які тренують моделі на масивних датасетах, Respeecher створював компактніші моделі. Вони не збирали дані з усього інтернету, не брали мільйони записів без перевірки, чи можна їх використовувати для тренування. Компанія скрупульозно ставилася до того, щоб дані були чисті.

Результат — набагато менші моделі, які можна розгортати всередині інфраструктури клієнта. Це важливо для банків, які не можуть дозволити, щоб розмови з клієнтами кудись йшли, а також для сфери healthcare, з чутливими даними. Держсектор, на думку Сердюка, потребує ще більшого контролю над безпекою даних.

У висновку Сердюк наголошує: «Я знаю, як гарантувати 100% безпеки — розгорнути систему на стороні клієнта. І це ми наразі можемо робити».

Чи були переговори з Мінцифрою

На запитання, чи були переговори з Мінцифрою, Сердюк підтвердив: «Були». Але деталі не розкрив — це те, що відбувається між вендором і клієнтом, і не виноситься у публічний простір до узгодження.

Він натякає на можливі причини, чому партнерство не відбулося. По-перше, Respeecher активно не маркетувала ці рішення — українські голоси та text-to-speech з’явилися відносно нещодавно. По-друге, вони не можуть собі дозволити давати величезні обсяги кредитів, щоб спочатку систему використовували безоплатно.

«Це, наскільки мені відомо, є стратегією багатьох провайдерів індустрії — залучити клієнта безплатними кредитами, а потім отримати виторг», — пояснює Сердюк.

Але, якщо система встановлюється на стороні клієнта, наприклад, у банк чи державну організацію — вартість використання не лежить на сторонньому провайдері. Організація сама контролює цю вартість, а провайдер отримує лише оплату за ліцензію, своє IP.

Що маємо у підсумку

Партнерство Мінцифри з ElevenLabs — досить амбітний та світовий крок у цифровізацію держсервісів. Голосова «Дія», ШІ-асистенти в освіті, доступність для людей з інвалідністю — все це має потенціал змінити взаємодію громадян із державою. Технологія ElevenLabs справді сильна, компанія має досвід роботи з Netflix і The Washington Post, а їхні моделі підтримують українську мову. Швидкість впровадження інновацій — це конкурентна перевага, і Мінцифра традиційно демонструє вміння запускати проєкти швидко.

Поза тим, залишаються запитання, на які хотілося б отримати чіткіші відповіді ще до запуску. Чому держава обрала партнера, технологію якого використовували для російської пропаганди проти України, у втручанні у вибори, для створення тисяч незаконних діпфейків — коли існує українська альтернатива з голлівудським досвідом і «Оскаром» у портфоліо?

Дисклеймер: Vector є партнером Respeecher і використовує їхню технологію для озвучування матеріалів на сайті.

Більше про це

Нейрокреатив в дії: як AI змінює ідеї в українському діджиталі — досвід Sasquatch Digital

Будь-яку статтю можна зберегти в закладки на сайті, щоб прочитати її пізніше.

Знайшли помилку? Виділіть її і натисніть Ctrl+Enter

Партнерські матеріали

Підписуйтеся і будьте в курсі найважливішого